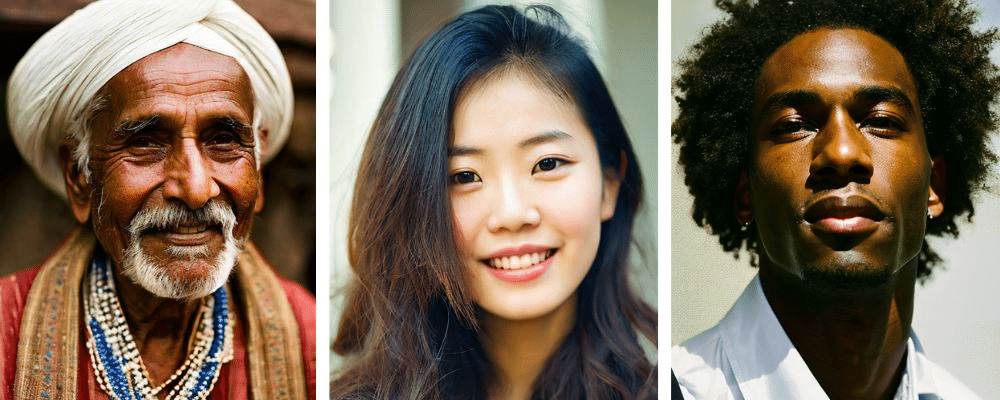

Die Fähigkeit, echte Bilder von KI-generierten Fälschungen zu unterscheiden, erweist sich als immer schwieriger, wie eine Studie der University of Waterloo zeigt. In einem Experiment konnten fast 40 Prozent der Teilnehmer echte Fotos nicht von KI-generierten Bildern unterscheiden, selbst nachdem sie explizit aufgefordert wurden, auf Details wie Finger, Zähne und Augen zu achten.

Dieses Ergebnis wirft nicht nur Fragen zu unserer Wahrnehmung und Unterscheidungsfähigkeit auf, sondern unterstreicht auch das Missbrauchspotenzial in der digitalen Welt.

Die Schwierigkeit des Unterscheidens

In dem Experiment wurden den 260 Teilnehmern 20 Bilder gezeigt, von denen die eine Hälfte echte Fotos und die andere Hälfte KI-generierte Bilder waren. Die Bilder, die mit Technologien wie Stable Diffusion und DALL-E erzeugt wurden, sollten von den Teilnehmern klassifiziert werden, obwohl sie wussten, dass es sich um eine Mischung aus echten und künstlichen Bildern handelte.

Trotz dieses Wissens und der Möglichkeit, die Bilder eingehend zu untersuchen, erreichten die Teilnehmer nur eine Genauigkeit von 60 %, weit entfernt von den erwarteten 85 %. Diese Ergebnisse deuten darauf hin, dass selbst sorgfältiges Betrachten nicht ausreicht, um fortgeschrittene KI-generierte Bilder von echten Bildern zu unterscheiden.

Testen Sie Ihre Wahrnehmung: Mimikama Bilderrätsel – Echt oder KI?

Potenzielle Gefahren

Die Studie beleuchtet die rasanten Fortschritte in der KI-Bildgenerierung, die nicht nur faszinierende Möglichkeiten eröffnen, sondern auch ernsthafte Risiken bergen. KI-generierte Bilder können für politische, kulturelle oder persönliche Desinformation genutzt werden, wobei insbesondere die Erstellung gefälschter Bilder von Personen des öffentlichen Lebens in diskreditierenden Szenarien hervorgehoben wird.

Die Wissenschaftlerin Andreea Pocol warnt vor den Gefahren dieser Entwicklung, zumal die Geschwindigkeit der technologischen Entwicklung oft die Kapazitäten der akademischen Forschung und der Gesetzgebung übersteigt.

Ein neues KI-Wettrüsten

Nach Einschätzung von Pocol stehen wir am Beginn eines neuen KI-Wettrüstens, bei dem die Entwicklung von Werkzeugen zur Erkennung von KI-generierten Bildern ebenso wichtig wird wie die Weiterentwicklung der Generierungstechnologien selbst. Angesichts der stetigen Verbesserung von KI-Technologien zur Bildgenerierung und der damit verbundenen Gefahr der Verbreitung von Desinformation ist die Entwicklung effektiver Methoden zur Erkennung von Fälschungen und zum Schutz der digitalen Integrität von entscheidender Bedeutung.

Fragen und Antworten zu KI-generierten Bildern

Frage 1: Warum ist es wichtig, zwischen echten und KI-generierten Bildern zu unterscheiden?

Antwort 1: Die Fähigkeit, echte von KI-generierten Bildern zu unterscheiden, ist entscheidend, um Desinformation zu bekämpfen und die Integrität digitaler Inhalte zu wahren.

Frage 2: Welche Herausforderungen stellen KI-generierte Bilder?

Antwort 2: Sie ermöglichen die einfache Erstellung von Desinformation und gefälschten Darstellungen, was sowohl politische als auch persönliche Risiken birgt.

Frage 3: Wie können wir uns vor den Gefahren KI-generierter Bilder schützen?

Antwort 3: Durch die Entwicklung und Anwendung von Technologien zur Erkennung von Fälschungen und durch die Förderung der digitalen Bildung.

Frage 4: Welche Rolle spielt die Gesetzgebung im Kampf gegen KI-generierte Fälschungen?

Antwort 4: Die Gesetzgebung kann dazu beitragen, den Missbrauch von KI-Technologien einzudämmen, muss aber mit der technologischen Entwicklung Schritt halten.

Frage 5: Was bedeuten die Ergebnisse der Waterloo-Studie für die Zukunft der digitalen Medien?

Antwort 5: Sie unterstreicht die Notwendigkeit, sowohl die technologischen als auch die gesellschaftlichen Fähigkeiten zur Unterscheidung und Bewertung digitaler Inhalte zu verbessern.

Fazit

Die Ergebnisse der Studie der University of Waterloo unterstreichen die Dringlichkeit, sich mit den Herausforderungen und Risiken von KI-generierten Bildern auseinanderzusetzen. In einer Zeit, in der digitale Inhalte eine immer größere Rolle in unserem Alltag spielen, ist es entscheidend, dass wir lernen, echte von künstlich erzeugten Bildern zu unterscheiden, um die Verbreitung von Desinformation einzudämmen. Dies erfordert nicht nur technologische Lösungen, sondern auch ein neues Bewusstsein für die Möglichkeiten und Gefahren dieser Technologien.

Quelle: Pressetext, University of Waterloo

Um auf dem Laufenden zu bleiben, abonnieren Sie den Mimikama-Newsletter und melden Sie sich für unsere Online-Vorträge und Workshops an.

Das könnte Sie auch interessieren:

Trump-Unterstützer setzen auf KI-Fakes

Wasserzeichen: Kein Allheilmittel gegen KI-Fakes

Sora: Revolution im Videodesign

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge entstanden durch den Einsatz von maschineller Hilfe und wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)