Heutzutage, da Bild- und Videomanipulationen an der Tagesordnung sind, werden Werkzeuge wie von Truemedia zur Erkennung und Neutralisierung von Deepfakes immer wichtiger. Diese Technologien sind nicht nur faszinierend, sondern auch unerlässlich, um die Integrität von Informationen zu wahren und die öffentliche Meinung vor Manipulation zu schützen. Fast jede Person des öffentlichen Lebens – von Politikern bis hin zu Popstars – kann zum Ziel solcher Fälschungen werden. Daher ist die Entwicklung von Erkennungswerkzeugen ein entscheidender Schritt zur Verteidigung der demokratischen Debatte.

Die Bedeutung der Erkennung von Deepfakes

Deepfakes sind hyperrealistische Fälschungen, die durch künstliche Intelligenz und maschinelles Lernen erstellt werden und das Potenzial haben, Wahlen zu beeinflussen, Finanzbetrug zu ermöglichen und Unruhen auszulösen. Jüngste Vorfälle, bei denen manipulierte Videos und Bilder in Umlauf gebracht wurden – beispielsweise gefälschte Anrufe von Joe Biden (wir haben hier darüber berichtet) oder gefälschte Nacktfotos von Taylor Swift (hier unser Artikel dazu) – unterstreichen die Dringlichkeit, solche Bedrohungen ernst zu nehmen und wirksam zu bekämpfen.

Truemedia.org und ihr Engagement

Die gemeinnützige Organisation Truemedia.org, gegründet von Oren Etzioni, einem Pionier auf dem Gebiet der künstlichen Intelligenz, hat sich dem Kampf gegen politische Deepfakes verschrieben. Ihre kürzlich veröffentlichte Beta-Version eines Deepfake-Detektors ermöglicht es, verdächtige Bild- und Tonaufnahmen schnell zu identifizieren. Die Plattform bietet auch die Möglichkeit, Beispiele von Deepfakes zu studieren und zu lernen, wie man sie erkennt, was für Medienschaffende, Regierungsmitarbeiter und professionelle Faktenchecker besonders wichtig ist.

Nachfolgend ein kurzes Demo-Video:

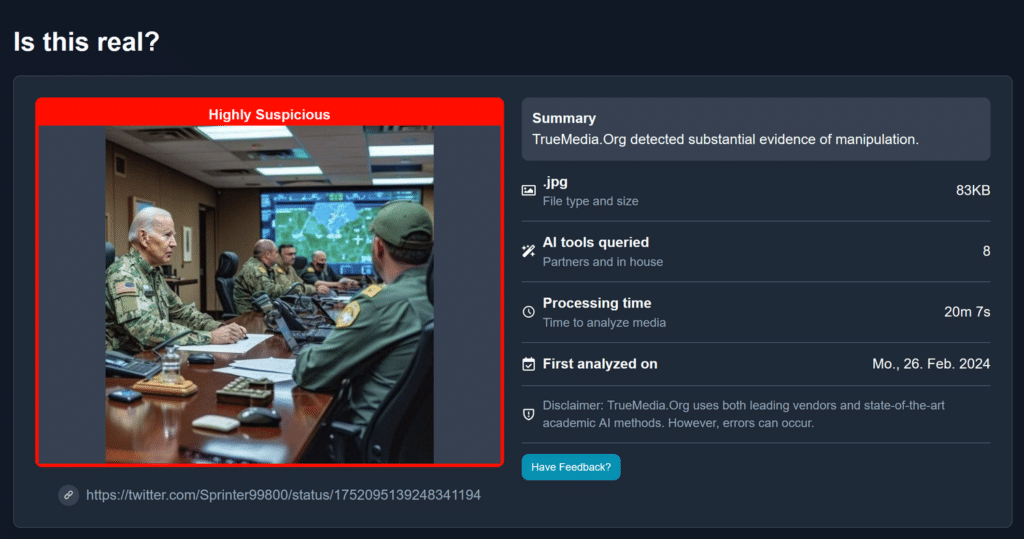

Hier ein Beispiel wie eine Analyse aussehen kann:

Screenshot der TrueMedia-Website; DerStandard

Technische Herausforderungen und Lösungen

Die Technologie hinter dem Detektor analysiert verschiedene Manipulationstechniken, vom Gesichtsaustausch bis hin zu subtileren visuellen und auditiven Veränderungen. Durch die Zusammenarbeit mit anderen Organisationen und die Verwendung fortschrittlicher Modelle zur Deepfake-Erkennung ist Truemedia.org bestrebt, ein robustes System zu entwickeln, das schnell und effektiv reagiert. Trotz dieser Fortschritte bleibt die Herausforderung bestehen, dass kein System jemals absolute Sicherheit bieten kann.

Fragen und Antworten zu Deepfakes:

Frage 1: Wie genau funktioniert der Deepfake Detector von Truemedia.org?

Antwort 1: Der Detector analysiert eingereichte Bilder und Videos auf Anzeichen von Manipulation, wie z.B. ungewöhnliche visuelle Artefakte oder Unstimmigkeiten in der Bildkomposition. Benutzer können URLs direkt in das Tool einfügen, um eine Analyse durchzuführen.

Frage 2: Was macht den Deepfake Detector von Truemedia.org einzigartig?

Antwort 2: Er kombiniert eigene Suchmethoden mit denen anderer führender Technologieanbieter, ist aber auf politische Inhalte spezialisiert, was ihn besonders in Wahlkampfzeiten relevant macht.

Frage 3: Ist der Zugang zum Deepfake Detector beschränkt?

Antwort 3: Ja, derzeit ist der Zugang auf vertrauenswürdige Gruppen wie Medien, Regierung und professionelle Faktenchecker beschränkt, um Missbrauch zu vermeiden und die Kosten gering zu halten.

Frage 4: Kann der Deepfake Detector jedes manipulierte Bild oder Video erkennen?

Antwort 4: Obwohl der Detector hoch entwickelt ist, gibt es keine Technologie, die eine 100%ige Erkennungsrate garantieren kann. Das Tool ist jedoch sehr effektiv bei der Erkennung der meisten Manipulationen.

Frage 5: Was sind die Herausforderungen bei der Weiterentwicklung von Deepfake Detektoren?

Antwort 5: Die größten Herausforderungen sind die ständige Weiterentwicklung der Deepfake-Technologie selbst und die Notwendigkeit, die Detektionsmethoden kontinuierlich anzupassen, um mit diesen Fortschritten Schritt zu halten.

Fazit

Deepfakes stellen eine ernsthafte Bedrohung für die Authentizität von Informationen und die Sicherheit des öffentlichen Diskurses dar. Werkzeuge wie der Deepfake Detector von Truemedia.org sind entscheidend, um diese Bedrohungen zu erkennen und zu neutralisieren. Die volle Wirksamkeit solcher Technologien hängt jedoch von der kontinuierlichen Forschung, der Anpassung an neue Methoden und der Zusammenarbeit zwischen verschiedenen Sektoren ab.

Um über die neuesten Entwicklungen und Techniken im Kampf gegen Desinformation auf dem Laufenden zu bleiben, empfehlen wir Ihnen, den Mimikama-Newsletter unter Newsletter zu abonnieren und sich für unsere Online-Vorträge und Workshops unter Medienbildung anzumelden.

Quelle: derStandard

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge entstanden durch den Einsatz von maschineller Hilfe und wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)