Der tägliche Kampf gegen Spam-Beiträge

Ich beobachte mit Sorge, wie eine Flut von pornografischem Spam viele Gruppen auf Facebook überschwemmt. Dieses Phänomen beschränkt sich nicht auf meine eigenen Gruppen, sondern ist ein weit verbreitetes Problem, das die Qualität und Sicherheit von Online-Communitys bedroht. Gruppenadministratoren stehen an vorderster Front. Sie investieren Zeit und Mühe, um diese unangemessenen Beiträge zu identifizieren und an Facebook zu melden, in der Hoffnung, dass das Unternehmen geeignete Maßnahmen ergreift.

Die Reaktion von Facebook ist jedoch oft enttäuschend. Viele der gemeldeten Beiträge werden nicht entfernt, da sie angeblich nicht gegen die Gemeinschaftsstandards verstoßen. Diese Reaktion ist ein Schlag ins Gesicht der Administratoren, die sich unermüdlich dafür einsetzen, ihre Gruppen frei von unangemessenen Inhalten zu halten.

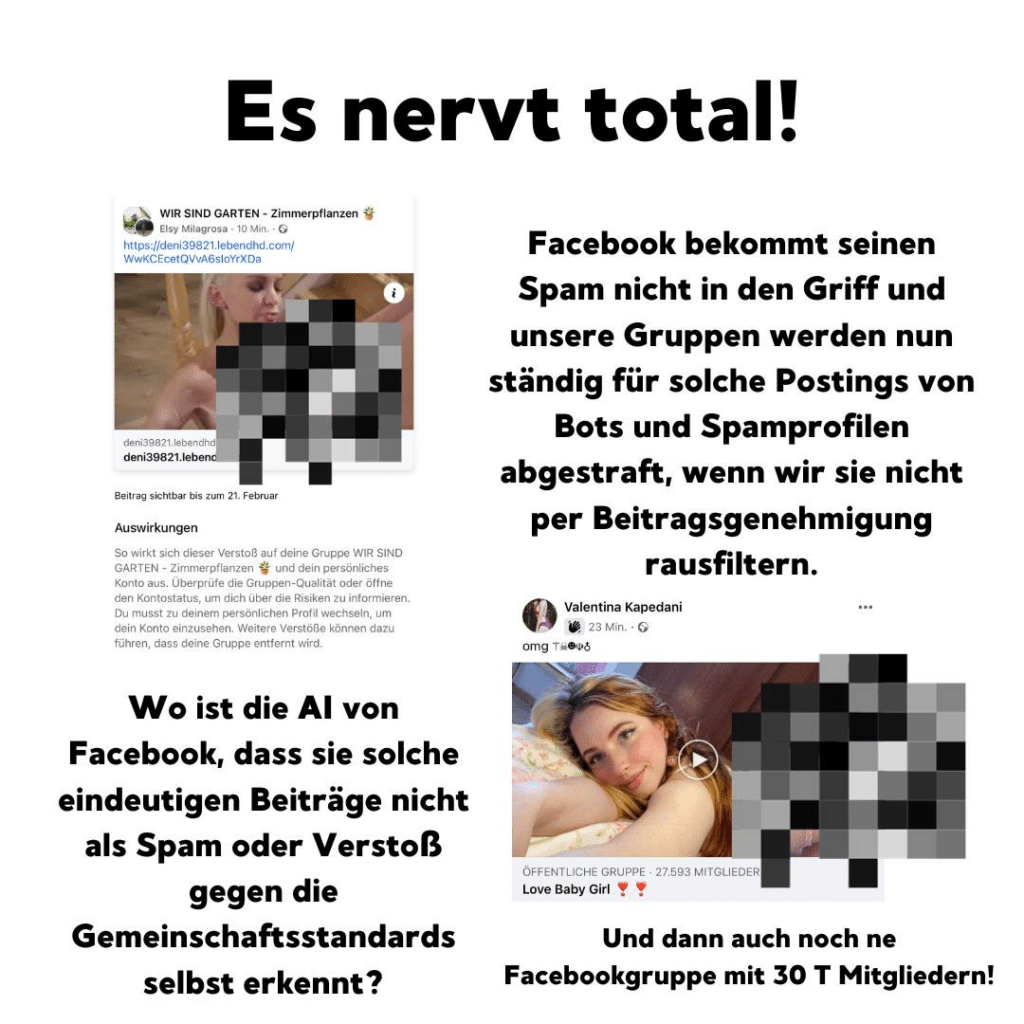

Die Problematik wurde von dem Gruppenadministrator der Gruppe „WIR SIND GARTEN – Zimmerpflanzen„, mit knapp 90.000 Mitgliedern auf Facebook, mit einem Bild veranschaulicht:

Die Ironie der Facebook-Moderation

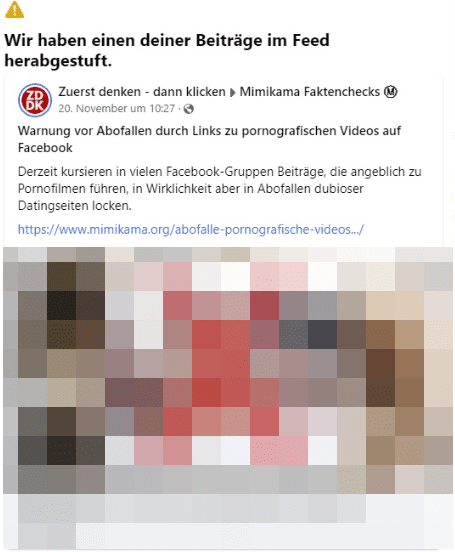

Die Ironie dieser Situation wird noch deutlicher im Zusammenhang mit unserer Arbeit bei Mimikama, einer Organisation, die sich der Aufklärung über Falschinformationen und Betrugsversuche im Internet widmet. Wir erstellen regelmäßig Faktenchecks, um die Nutzer über genau die Art von Betrugsversuchen zu informieren, die in diesen Spam-Nachrichten verbreitet werden. Paradoxerweise wird unser Engagement für Wahrheit und Aufklärung von Facebook selbst nicht unterstützt, sondern sogar bestraft. Wir erleben Sanktionen und Abmahnungen für das Teilen von Fakten und aufklärenden Inhalten.

Diese Erfahrung ist frustrierend und man hat das Gefühl, in einer verkehrten Welt zu leben

In dieser Welt werden diejenigen, die sich für die Verbreitung der Wahrheit und die Aufdeckung von Fehlinformationen einsetzen, als die Bösen angesehen. Das ist so, als würde man einen Feuerwehrmann dafür bestrafen, dass er einen Brand löscht – eine völlig absurde Vorstellung.

Diese Erfahrung von Mimikama zeigt die Probleme und Widersprüche in der Moderationspolitik von Facebook auf, die dringend angegangen und überarbeitet werden müssen.

Künstliche Intelligenz: Fluch oder Segen?

Facebooks Einsatz von künstlicher Intelligenz (KI) im Kampf gegen Spam und irreführende Inhalte ist ein zweischneidiges Schwert, das sowohl Potenzial als auch Probleme birgt. Facebooks Strategie, KI einzusetzen, um Spam-Posts und betrügerische Konten zu identifizieren und zu blockieren, klingt zunächst vielversprechend. Bei näherer Betrachtung zeigen sich jedoch gravierende Schwächen dieses Ansatzes.

Ein zentrales Problem ist, dass KI-Systeme nicht immer effektiv zwischen echten, legitimen Inhalten und Spam oder betrügerischen Beiträgen unterscheiden können. Anstatt die eigentlichen Quellen des Übels – Spam-Profile und automatisierte Bots – zu identifizieren und zu blockieren, konzentriert sich die KI-Technologie oft fälschlicherweise auf die Gruppen selbst. Dies führt zu einer Reihe ungerechtfertigter Maßnahmen gegen gutwillige Gruppen und ihre Administratoren. Gruppen werden verwarnt, in ihren Funktionen eingeschränkt oder im schlimmsten Fall ganz gelöscht. Besonders ironisch und frustrierend ist dies für die Administratoren, die oft selbst unter den Spamwellen leiden und aktiv dagegen vorgehen.

Die Rolle von Mimikama im Kampf gegen Falschinformation

Inmitten dieses Wirrwarrs versucht Mimikama, eine Plattform für Faktenchecks und Aufklärung, eine klare und verlässliche Informationsquelle zu sein. Sie setzen sich für die Aufklärung über Falschinformationen und betrügerische Inhalte ein und warnen regelmäßig vor solchen Spam-Beiträgen. Aber auch sie stehen vor großen Herausforderungen.

Anstatt von Facebook Unterstützung für ihre wichtige Aufklärungsarbeit zu erhalten, werden sie paradoxerweise für ihre Bemühungen bestraft. Diese paradoxe Situation ist bezeichnend für das aktuelle Klima auf der Plattform: Diejenigen, die warnen und aufklären, werden zu denen, vor denen gewarnt wird.

Fragen, die uns alle betreffen

Diese Entwicklungen werfen wichtige und beunruhigende Fragen auf, die weit über die Grenzen von Facebook hinausgehen und uns alle betreffen sollten.

Warum werden die wahren Probleme – die Verbreitung von Spam und Falschinformationen durch betrügerische Profile und Bots – auf der Plattform ignoriert oder nicht effektiv angegangen, während diejenigen, die sich für Aufklärung und Wahrheit einsetzen, bestraft werden?

Ist es nicht ein alarmierendes Zeichen falsch gesetzter Prioritäten, wenn Betrüger scheinbar freie Hand haben, während diejenigen, die das Bewusstsein für solche Betrügereien schärfen und zur Aufklärung beitragen, zum Schweigen gebracht werden? Diese Fragen sind von zentraler Bedeutung und sollten uns alle zum Nachdenken und Handeln anregen.

Fazit:

Facebook muss seine Rolle als Plattform für Meinungsfreiheit und Aufklärung ernst nehmen. Wir von Mimikama werden unseren Kampf für die Wahrheit fortsetzen. Wir brauchen Ihre Unterstützung, um ein Netzwerk zu bilden, das stark genug ist, diese Ungerechtigkeiten zu bekämpfen. Lassen Sie uns gemeinsam für eine Welt eintreten, in der die Wahrheit geschätzt und verteidigt wird.

Gemeinsam sind wir laut. Gemeinsam sind wir stark. Gemeinsam können wir etwas bewirken.

Lesen Sie auch:

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge entstanden durch den Einsatz von maschineller Hilfe und wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)