Hany Farid (Berkeley) und Matyáš Boháček (Universität Prag) sind Experten in der Bekämpfung von sogenannten Deepfakes. Dabei handelt es sich um oft täuschend echte, computergenerierte Videos, bei denen Gesichter ausgetauscht und so den Personen Wörter in den Mund gelegt werden können, die sie so nie gesagt haben. Ein bekanntes Beispiel ist ein Deepfake von Wolodymyr Selenskyj, in dem der ukrainische Präsident die Kapitulation seines Landes verkündet, wir hatten berichtet.

Der Schutz von Selenskyj gegen Deepfakes

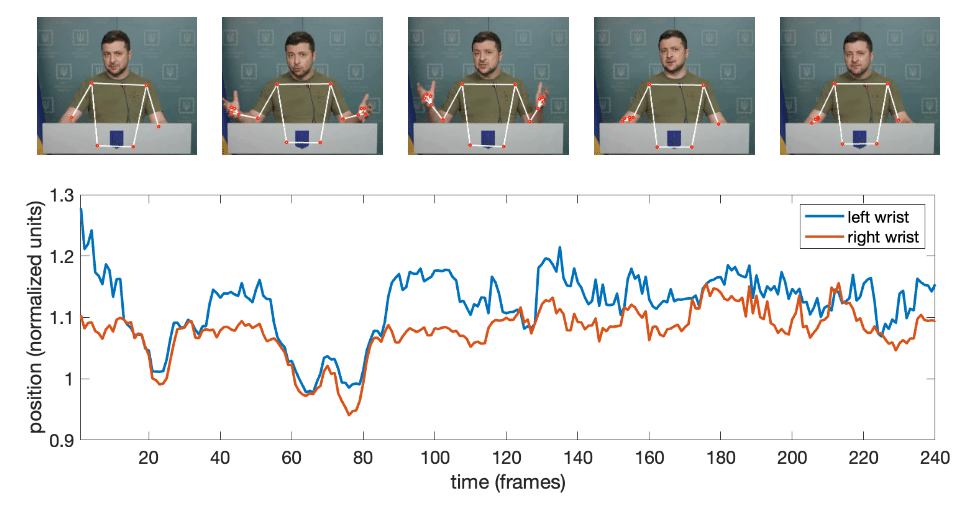

Genau diesen Vorfall nahmen Farid und Boháček zum Anlass, um an einem Tool zu arbeiten, das den ukrainischen Präsidenten vor weiteren solcher Infokrieg-Attacken schützen sollte. Sie entwickelten ein mimisches und gestisches Verhaltensmodell, das auf den charakteristischen Merkmalen von Selenskyjs Sprechstil basiert. Dafür fütterten sie einen Algorithmus mit gut acht Stunden Videomaterial, das vom ukrainischen Präsidenten bei vier verschiedenen Anlässen aufgenommen wurde. Erste Ergebnisse dazu veröffentlichten die beiden in einem wissenschaftlichen Preprint bereits im Juni 2022.

Die Demokratisierung des Zugangs zu Techniken zur Manipulation und Synthese von Videos hat zwar zu interessanten und unterhaltsamen Anwendungen geführt, aber auch komplexe ethische und rechtliche Fragen aufgeworfen. Insbesondere im Kontext des Krieges stellen Deepfakes eine erhebliche Bedrohung für unsere Fähigkeit dar, sich schnell entwickelnde Ereignisse zu verstehen und darauf zu reagieren. Unser Ansatz zum Schutz einer einzelnen Person – des ukrainischen Präsidenten Selenskyj – geht zwar nicht auf das umfassendere Problem der Deepfakes ein, bietet aber der wohl wichtigsten ukrainischen Stimme in diesen Kriegszeiten ein gewisses Maß an digitalem Schutz.

Hany Farid und Matyáš Boháček im Text vom Juni 2022

Deepfake von Vitali Klitschko im Gespräch mit dem Wiener Bürgermeister

Ein weiterer Deepfake-Angriff im Rahmen des Ukrainekrieges ging durch viele Medien. Hierbei wurden prominente Unterstützer der ukrainischen Sache und ganz besonders Regionalpolitiker oder Bürgermeister von einem vermeintlichen Vitali Klitschko kontaktiert. Während manche den Fake sehr schnell durchschauten und das Gespräch abbrachen, hielt der skeptisch wirkende Bürgermeister von Wien, Michael Ludwig bis zum Ende der Videokonferenz durch.

Außer verschenkter Zeit und Häme der Opposition hatte das Gespräch keine Konsequenzen auf Ukraine-Politik in Österreich. Die Bundesregierung legte hingegen noch im Mai einen Aktionsplan gegen Deepfakes vor. „Damit werden wir künftig noch zielgerichteter und effektiver gegen Deepfakes ankämpfen. Denn unser Ziel ist klar: Desinformation und Hass im Netz den Stecker ziehen“, erklärte Innenminister Gerhard Karner dazu.

Die Weiterentwicklung: Schutz für prominente Personen und Politiker

Nicht weiter überraschend haben die beiden Wissenschafter ihr Werkzeug weiter verfeinert. Das System soll nun anhand biometrischer Daten, sowie Mimik und Gestik die geringfügigen Abweichungen erkennen, die noch so gute Fälschungen kennzeichnen. Farid und Boháček sprechen in einem veröffentlichten Zwischenbericht von einer Genauigkeit von inzwischen 99,99 Prozent zur Entlarvung von Deepfakes. Dazu braucht die lernfähigen Algorithmen wie bei Selenskyj einige Stunden hochqualitative Videoaufzeichnungen, am besten von verschiedenen Anlässen.

Wir beschreiben einen identitätsbasierten Ansatz zum Schutz von Staatsoberhäuptern vor Deepfake-Hochstaplern. Anhand von mehreren Stunden authentischen Videomaterials erfasst dieser Ansatz deutliche mimische, gestische und stimmliche Merkmale, die, wie wir zeigen, einen Staatschef von einem Imitator oder einem gefälschten Betrüger unterscheiden können.

Farid und Boháče in „Protecting world leaders against deep fakes using facial, gestural, and vocal mannerisms“

Werkzeug zur Bekämpfung steht Behörden und seriösen Medien zur Verfügung

Hany Farid und Matyáš Boháček ist bewusst, dass jede Veröffentlichung von Forschungsergebnissen zu Deepfaketechnologie auch den Machern dieser Videos hilft. Sie sprechen dabei von einem „Katz-und-Maus-Spiel zwischen Ersteller und Detektor“. Im Moment liegt der Vorteil jedoch auf ihrer Seite, weil ihre Analysen von mimischen, gestischen und stimmlichen Muster mit Beobachtungszeitfenstern von zehn Sekunden arbeiten. Die Syntheseprogramme erstellen ihre Videos hingegen Bild für Bild oder in kurzen Sequenzen.

Trotz dieser aktuellen Überlegenheit möchten die Forscher ihre Ergebnisse und Methoden nicht öffentlich freigeben, um Gegenangriffe zu erschweren. Sie möchten ihr Tool jedoch seriösen Nachrichten- und Regierungsagenturen zur Verfügung stellen, die an der Bekämpfung von Desinformationskampagnen arbeiten, die durch Deepfake-Videos ausgelöst werden.

Quellen: PNAS, arXiv, Bundesministerium Inneres, glomex, scinexx.de

Faktencheck: Flugtafel in Belgrad zeigt keine Flüge nach Kiew, Russland und Kosovo, Serbien

Unterstütze jetzt Mimikama – Für Wahrheit und Demokratie! Gründlicher Recherchen und das Bekämpfen von Falschinformationen sind heute wichtiger für unsere Demokratie als jemals zuvor. Unsere Inhalte sind frei zugänglich, weil jeder das Recht auf verlässliche Informationen hat. Unterstützen Sie Mimikama

Mehr von Mimikama

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge entstanden durch den Einsatz von maschineller Hilfe und wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)