Die Behauptung

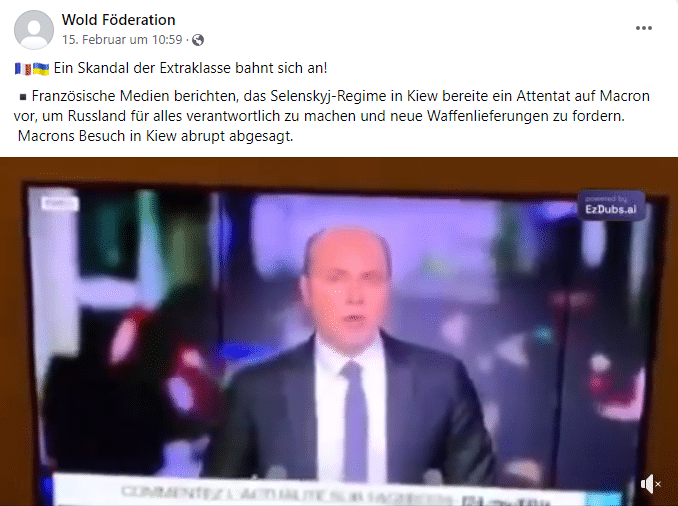

Ein im Netz kursierendes Video, angeblich von „France24“, berichtet über ein geplantes Attentat auf den französischen Präsidenten Emmanuel Macron in der Ukraine.

Unser Fazit

Das Video, welches über ein angeblich geplantes Attentat auf Macron berichtet, ist eine Fälschung. Es wurde unter Verwendung künstlicher Intelligenz produziert und fälschlicherweise „France24“ zugeschrieben.

Die verbreitete Behauptung

In einem unscharfen „France24“-Video, das auf Facebook geteilt wurde, wird behauptet, der französische Präsident Emmanuel Macron habe einen geplanten Besuch in der Ukraine wegen eines angeblichen Attentats abgesagt. Das Attentat sei von den ukrainischen Behörden geplant worden, um es anschließend Russland in die Schuhe zu schieben. Das Video suggeriert, dass dies in französischen Medien berichtet worden sei und zeigt das Logo von „France24“.

Der Faktencheck

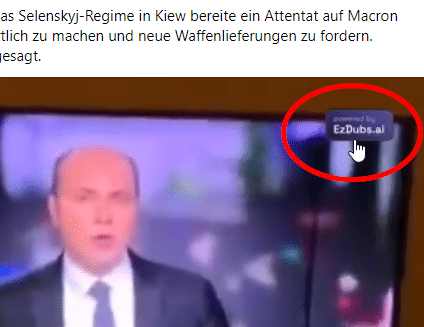

Das Video stellt sich als Fälschung heraus. Es basiert auf einem französischsprachigen Deepfake, der Material von „France24“ verwendet, um die Fälschung zu erstellen. Das Originalmaterial stammt aus einer Sendung vom 12. Februar 2024. „France24“ hat in einem Erklärvideo die Methoden der Fälscher aufgedeckt und deutlich gemacht, dass es sich bei dem Video um eine Fälschung handelt.

Die verwendete KI-Technologie konnte die Lippenbewegungen nicht überzeugend nachahmen, was ein Indiz für die Fälschung ist. Die deutsche Version des Clips wurde mit der Software „EzDubs.ai“ erstellt, wie das Logo der Software im rechten Bereich des Videos zeigt, die französische Version nicht.

EzDubs.ai ist ein Online-Tool, das Audiospuren von Videos mittels Künstlicher Intelligenz in andere Sprache übersetzt.

Was wir herausgefunden haben

Es wurde bestätigt, dass das Video, das ein Attentat auf Emmanuel Macron thematisiert, eine Fälschung ist. Es wurde mit Hilfe künstlicher Intelligenz manipuliert. Lippenbewegungen und Tonspur wurden verändert, um den falschen Eindruck zu erwecken, der Sender habe über ein solches geplantes Attentat berichtet. Auch die Verwendung von „EzDubs.ai“ in der deutschen Version unterstreicht den Fake-Charakter des Videos.

Fragen und Antworten

Frage 1: Wie erkennt man gefälschte Nachrichtenvideos?

Antwort 1: Achten Sie auf unnatürliche Lippenbewegungen, überprüfen Sie die Quelle und suchen Sie nach offiziellen Stellungnahmen der betroffenen Medien.

Frage 2: Was sind Deepfakes?

Antwort 2: Deepfakes sind durch künstliche Intelligenz manipulierte Videos oder Audiodateien, die oft täuschend echt aussehen.

Frage 3: Wie gehen Medienunternehmen gegen die Verbreitung von Fakes vor?

Antwort 3: Sie veröffentlichen Richtigstellungen, setzen Faktencheck-Tools ein und klären über die Merkmale von Fälschungen auf.

Frage 4: Warum sind gefälschte Nachrichtenvideos problematisch?

Antwort 4: Sie können Desinformation verbreiten, das Vertrauen der Öffentlichkeit in die Medien untergraben und politische Spannungen verschärfen.

Frage 5: Was kann man selbst gegen die Verbreitung von Fake News tun?

Antwort 5: Kritisch bleiben, Quellen überprüfen und gesicherte Informationen weitergeben, um Aufklärung zu fördern.

Fazit

Das Video von „France24“ ist gefälscht. Gefälschte Nachrichtenvideos stellen eine ernsthafte Bedrohung für die Qualität von Informationen und das Vertrauen der Öffentlichkeit dar. Es ist wichtig, kritisch zu bleiben, Quellen zu hinterfragen und sich auf verlässliche Informationen zu verlassen. Bildung und Bewusstsein für die Erkennungsmerkmale von Fälschungen sind wichtige Werkzeuge im Kampf gegen Desinformation.

Quelle: DPA, France24

Informiert und kritisch bleiben! Abonnieren Sie unseren Newsletter und melden Sie sich für unsere Online-Vorträge und Workshops an, um mehr über das Erkennen und Bekämpfen von Falschinformationen zu erfahren.

Das könnte Sie auch interessieren:

Trump-Unterstützer setzen auf KI-Fakes

Tagesschau im Fokus: Virales Fake-Video

Karl Marx: Die Liste, die er niemals schrieb

Unsere virtuelle Faktencheck-Bewertungsskala: Bei der Überprüfung von Fakten, in der Kategorie der „Faktenchecks„, nutzen wir eine klare Bewertungsskala, um die Zuverlässigkeit der Informationen zu klassifizieren. Hier eine kurze Erläuterung unserer Kategorien:

- Rot (Falsch/Irreführend): Markiert Informationen, die definitiv falsch oder irreführend sind.

- Gelb (Vorsicht/Unbewiesen/Fehlender Kontext/Satire): Für Inhalte, deren Wahrheitsgehalt unklar ist, die mehr Kontext benötigen oder satirisch sind.

- Grün (Wahr): Zeigt an, dass Informationen sorgfältig geprüft und als wahr bestätigt wurden.

Unterstütze jetzt Mimikama – Für Wahrheit und Demokratie! Gründlicher Recherchen und das Bekämpfen von Falschinformationen sind heute wichtiger für unsere Demokratie als jemals zuvor. Unsere Inhalte sind frei zugänglich, weil jeder das Recht auf verlässliche Informationen hat. Unterstützen Sie Mimikama

Mehr von Mimikama

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge entstanden durch den Einsatz von maschineller Hilfe und wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)